Această poveste este distribuită din buletinul informativ Substack Big Technology; abonați-vă gratuit aici

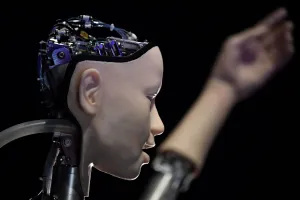

Acum acel program AI vorbește cu noi în limbaj natural, întoarce-ne gândurile în ilustrații , și întruchipa vocile noastre , un conflict major asupra eticii lor este pe drum.

Și dacă ați crezut că lupta pentru moderarea conținutului a fost intensă, așteptați-o pe aceasta.

Miza este modul în care chatboții abordează problemele politice, modul în care ilustratorii AI înfățișează lumea și dacă unele aplicații precum emulatorii de voce ar trebui chiar să existe. Având în vedere amploarea și puterea acestei tehnologii înfloritoare, activiștii nu vor fi subtili. Au avut practica lor luptă pentru vorbirea umană online și vor aduce această experiență în acest război. Ar putea deveni dezordonat rapid.

„Toată lumea are cuțitele ascuțite”, a spus Sam Lessin, un capitalist de risc și fost director pe Facebook. „Cel puțin în ceea ce privește vorbirea, toată lumea a fost puțin dezorientată și nu a înțeles cu adevărat. Acesta, ei sunt de genul: „La naiba, am mai văzut acest joc înainte.” Fiecare lobby din lume este gata să-și scrie scrisorile și să-și înceapă campaniile de influență.”

Inteligența AI poate fi artificială, dar oamenii îi codifică valorile. OpenAI, de exemplu, decide în mod eficient dacă ChatGPT ia poziție cu privire la pedeapsa cu moartea (fără opinie), tortură (se opune) și dacă un bărbat poate rămâne însărcinat (se spune nu). Cu ilustratorul său AI Dall-E, organizația influențează ce tip de persoană îl înfățișează tehnologia atunci când atrage un CEO. În fiecare caz, oamenii din culise iau decizii. Și oamenii sunt influențabili.

La fel ca moderarea conținutului, vor exista unele decizii etice evidente, de consens pentru IA generativă (nu doriți ca chatbots să susțină genocidul, de exemplu), dar susținătorii își vor miza terenul în gri. „Este un instrument foarte puternic și oamenii vor dori să facă o gamă largă de lucruri cu el pentru a-și satisface propriile interese”, a spus Lessin. „Dacă te uiți la modul în care s-au desfășurat chestiile despre libertatea de exprimare, se va desfășura din nou la fel, doar mai repede.”

Zonele potențiale de conflict includ modul în care AI abordează rasa, genul, războiul și alte probleme spinoase. ChatGPT, într-o conversație recentă, a enumerat mai multe beneficii ale câștigării Ucrainei în războiul împotriva Rusiei. Dar i s-a cerut să enumere rezultatele pozitive din câștigarea războiului Rusiei, a refuzat. ChatGPT moralizează foarte mult. „Războiul este un eveniment grav și devastator și ar trebui evitat întotdeauna dacă este posibil”, a spus botul, într-o interacțiune tipică. „Cel mai bun rezultat este întotdeauna pacea și rezoluția diplomatică.”

Deciziile etice pentru IA generativă sunt mize deosebit de mari, deoarece se extind. Când codificați valori într-un chatbot, acesta poate împinge acele valori în mod repetat în conversație. Când luați o decizie de moderare a conținutului, în cele mai multe cazuri, aceasta implică doar o persoană și o singură bucată de conținut.

Cel mai bun mod de a gestiona această nouă putere este să îi puneți pe roboți să o joace cât mai echitabil posibil, a spus dr. Jeffrey Howard, profesor de științe politice la UCL din Londra. „Aceste judecăți de valoare sunt inevitabile”, a spus el. „Una dintre judecățile de valoare ar putea fi construirea unui anumit tip de neutralitate și imparțialitate.”

În cele din urmă, descentralizarea IA generativă poate elibera o parte din tensiune. În timp ce vorbirea este relativ centralizată online astăzi, există mulți dezvoltatori care lucrează la IA generativă. Și pe măsură ce dezvoltatorii construiesc aplicații cu propria lor morală, un război total asupra politicilor puterilor centrale poate dispărea. Dar, între timp, așteptați-vă la multe poziționări, convingeri și lupte pentru etica pe care marii jucători o construiesc în modelele lor.